手机里的电话语音和网络通话走的是两套完全不同的底层架构。更棘手的是,加密后的语音数据要在有损的运营商网络中实时传输,每 20 毫秒一帧,不能断、不能卡、不能失真。这不是套一层 AES 就能解决的问题。

🤔 一个”简单”的问题

“端到端加密”这个词,这几年被用得有点泛滥。几乎每个通信应用都声称自己支持端到端加密。

于是你可能会觉得:语音加密不就是在发送端加密、接收端解密吗?选个靠谱的加密算法,AES-256 套上去,搞定。

如果你是这么想的,那接下来的内容可能会让你重新审视这件事。

因为真正的困难,不在”加密”这两个字上。

⚠️ 为什么值得关注

从 SS7 到 Altamides:基础设施本身就不安全

2014 年,在德国汉堡举办的第 31 届混沌通信大会上,安全研究员 Tobias Engel 现场演示了对 SS7 信令协议的攻击。SS7 是全球电信网络的核心信令协议,诞生于 1980 年代,设计之初假设只有少数可信运营商会接入——所以协议本身没有认证机制。

Engel 仅凭一个电话号码,在几分钟内就追踪到了目标手机的地理位置,精度达到 50 米。

你可能会说,那是十多年前的事了。

2024 年,国际调查组织 Lighthouse Reports 联合 13 家媒体伙伴披露了一款名为 Altamides 的商业监控工具。这款由奥地利公司开发的系统利用 SS7 协议漏洞,在长达十多年的时间里实时追踪了全球 160 个国家、超过 14,000 个手机号码的位置信息。

💡 更令人警觉的是,安全研究机构 Enea 在 2024 年底还发现了一种新型的 SS7 绕过攻击——攻击者通过畸形 TCAP 消息绕过运营商安全防护,可以在不触发任何告警的情况下拦截短信、重定向通话和追踪位置。

这意味着 SS7 的安全漏洞不仅没有被修复,攻击手段还在持续进化。

🤖 AI 让语音监听的成本断崖式下降

传统上,语音监听需要人工实时收听或录音后回放,效率极低。但今天的情况完全不同。

自动语音识别(ASR)技术在清晰语音场景下的词错误率已降至 3.5% 左右。这意味着机器转写的准确率已经接近甚至超过普通人工听写的水平。

再叠加大语言模型的语义理解和摘要能力——被截获的语音数据不只是能被”听到”,而是能被批量地”理解”、”摘要”和”分析”。

💡 更值得警惕的是 AI 语音克隆技术的爆发。攻击者仅需 30 秒的音频样本,就能克隆一个人的声音,进行实时通话欺诈。2024 年,全球合成语音欺诈事件同比增长了 1300%。

研究显示,人类对合成语音的正确识别率仅为 37.5%——低于随机猜测。

也就是说:你的通话内容可以被自动转写分析,你的声音可以被克隆冒充,而你甚至无法分辨对面说话的人是不是真人。

🏗️ 自建 VoIP?不现实

面对这样的威胁,一个直觉反应是:自建通信系统。但 VoIP 系统的建设涉及信令服务器、媒体服务器、编解码器适配、网络穿越、终端兼容等一系列技术栈,实现复杂、成本高昂。

✅ 真正具备可行性的方案是:在现有设备和网络上,无缝接入一个端到端的加密框架。语音数据在发送端加密,传输过程中不可读,在接收端解密还原。

原理很清晰。但工程实现远比想象中复杂。

🎯 第一个难题:语音从哪来?

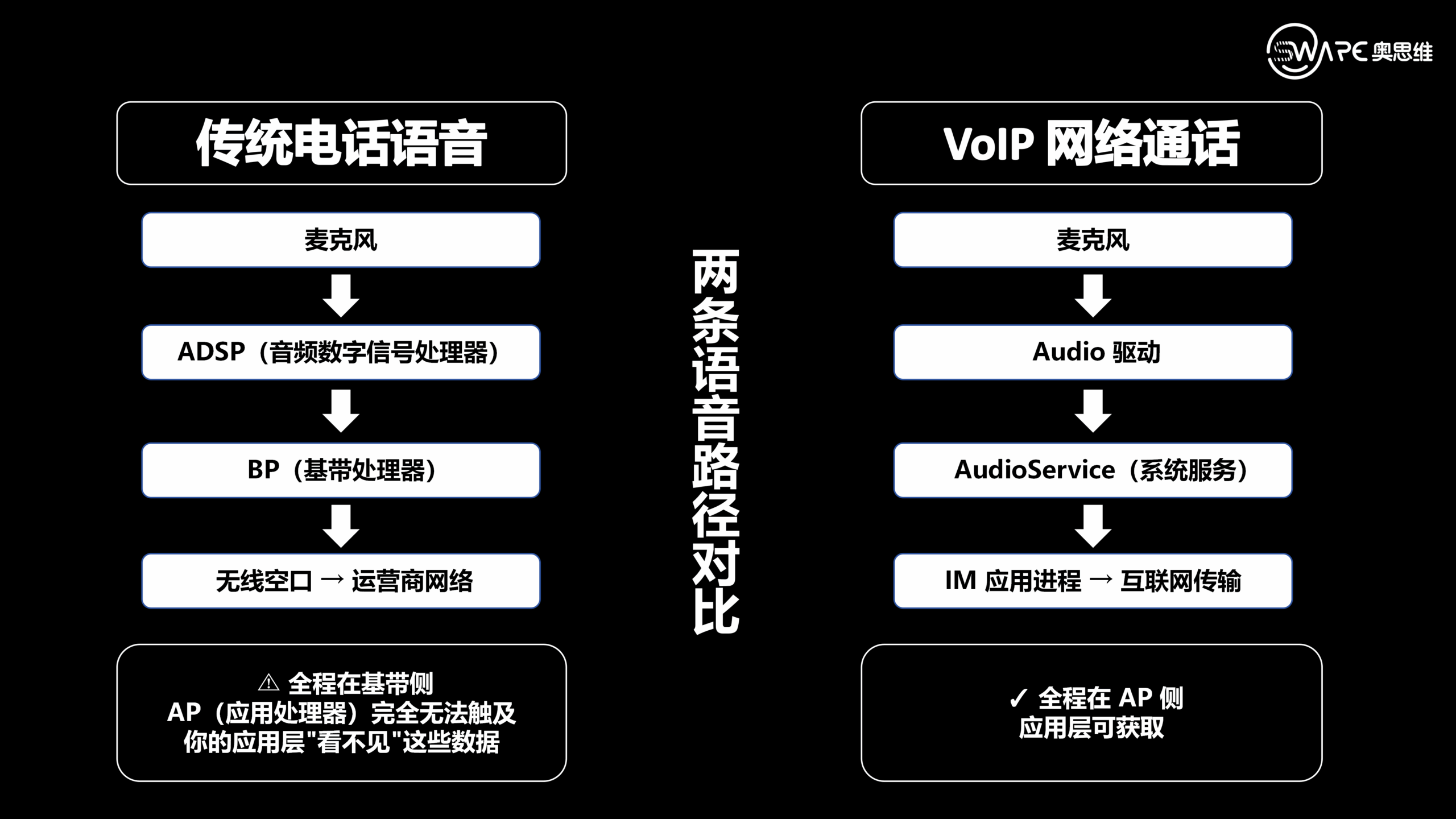

以 Android 智能手机为例,手机里的语音通话有两条完全不同的底层路径。

当你打一个普通的 2G/3G/4G 电话时,语音数据走的是 麦克风 → ADSP → BP → 无线空口 的路径。整个过程在基带侧完成,应用处理器(AP)——也就是你的 Android 系统和所有应用运行的地方——根本拿不到语音数据。

而 VoIP 通话恰恰相反:语音数据全程在 AP 侧流动,从硬件驱动层到 Android 的 AudioService 系统服务,最后进入 IM 应用进程内部。

这意味着:两条路径的底层架构完全不同,操作系统层面的访问权限也截然不同。

要做”融合”加密——也就是一个框架同时覆盖电话通话和网络通话——必须设计一个统一的语音源获取框架,能够跨越 AP 和 BP 两个世界,在不同的芯片平台和系统版本上稳定工作。

⏱️ 20 毫秒:没有商量余地的硬约束

语音通话中,每 20 毫秒产生一帧语音数据。这不是一个”尽力而为”的指标,而是硬实时约束——一旦丢帧,用户就能感知到卡顿。

20 毫秒是什么概念?

人类眨一次眼大约 300-400 毫秒。也就是说,在你眨一次眼的时间里,语音框架已经处理了 15-20 帧数据。留给跨系统通信的时间以及加密和解密处理的时间就非常少。

打个比方:这相当于在高速公路和铁路之间建一个换乘站,每辆车只允许停 20 毫秒——你不仅要确保换乘流程在时间窗口内完成,还要确保这个换乘站在各种天气条件下都能正常运转。

📡 第二个难题:加密后的数据怎么在有损网络里活下来?

假设我们已经解决了语音源获取的问题(这本身已经很有挑战),下一个问题自然浮出水面:加密后的数据怎么传输?

模拟加密 vs 数字加密:为什么只有一条路

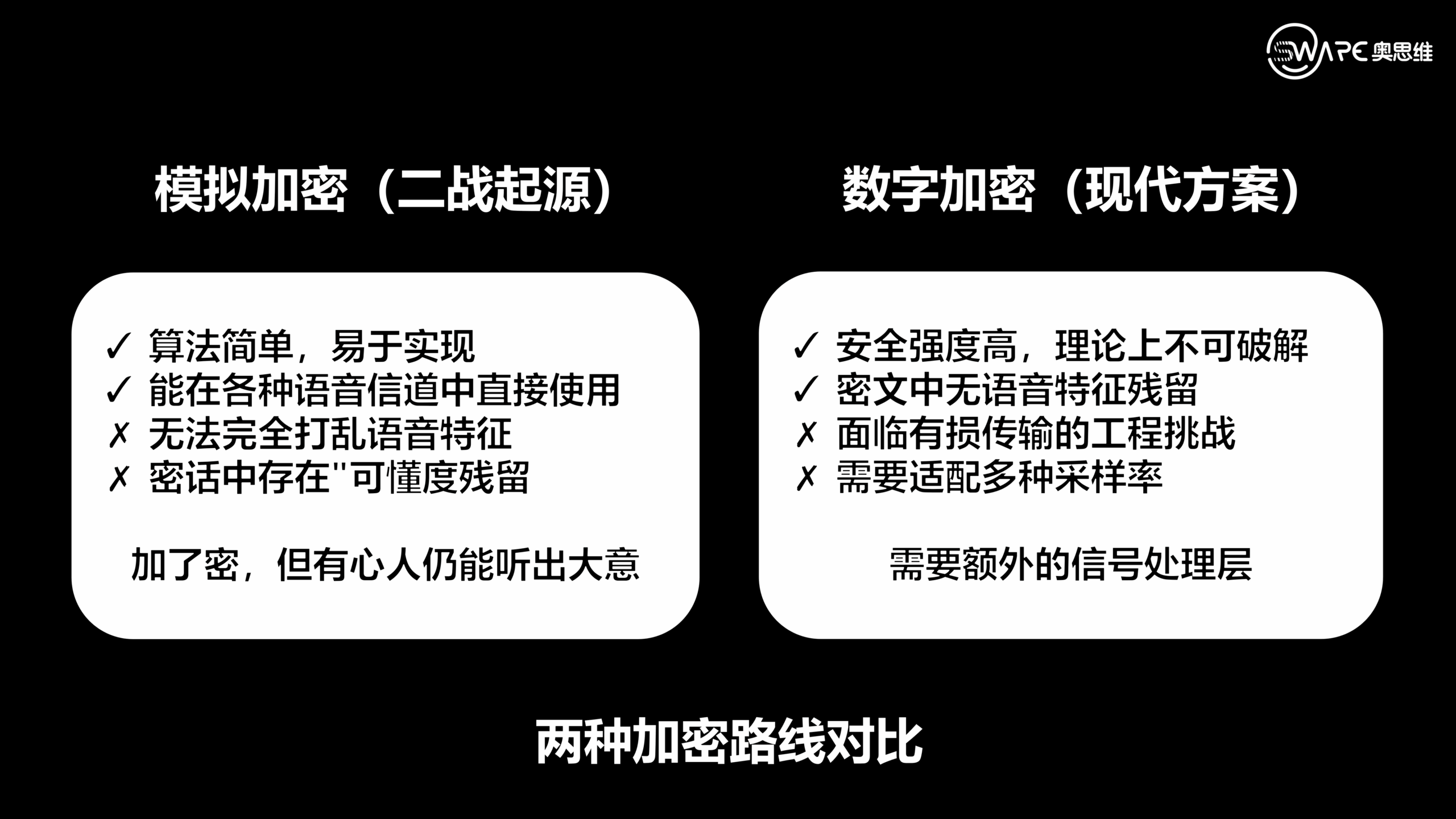

语音加密在技术路线上有两个选择:

模拟加密是从二战时期发展起来的语音保密技术,它通过对音频波形进行变换来实现加密。优点是简单直接,能在各种语音信道中使用。

⚠️ 然而,它有一个致命缺陷:无法完全打乱语音的时频特征。加密后的音频中仍然残留着原始语音的节奏、语调和韵律特征——这就是所谓的”可懂度残留”。

在现代的计算能力和信号分析技术面前,这种加密基本形同虚设。

所以,数字加密是唯一现实的选择。但数字加密在手机端落地时,面临着两个严峻的工程挑战。

挑战一:采样率丛林

普通电话的语音采样率通常是 8K/16K/32K Hz,VoIP 电话一般是 16K/32K/48K Hz。不同的采样率意味着不同的数据量和编码格式。

✅ 加密框架必须能够透明地适配这些差异,而不需要上层应用或底层硬件做任何修改。

挑战二:有损传输——真正的硬骨头

这是整个技术链路中最关键的难点。

语音数据经过数字加密后,已经不再是”语音”了——它变成了一串看起来像随机噪声的数字流。但这串数据接下来还要经过运营商网络的语音编解码器(声码器)进行压缩传输。

⚠️ 问题在于:声码器是为人类语音设计的。 它的压缩算法基于人类语音的声学模型,能够高效地压缩和还原语音信号。但当它遇到”噪声”(也就是加密后的数据流)时,压缩损耗会被急剧放大。

更麻烦的是,在跨运营商通话场景中,语音数据可能会经过多次编解码,损耗层层叠加。一旦总损耗超过某个临界点,接收端就无法正确还原加密前的数据,语音质量会断崖式下降。

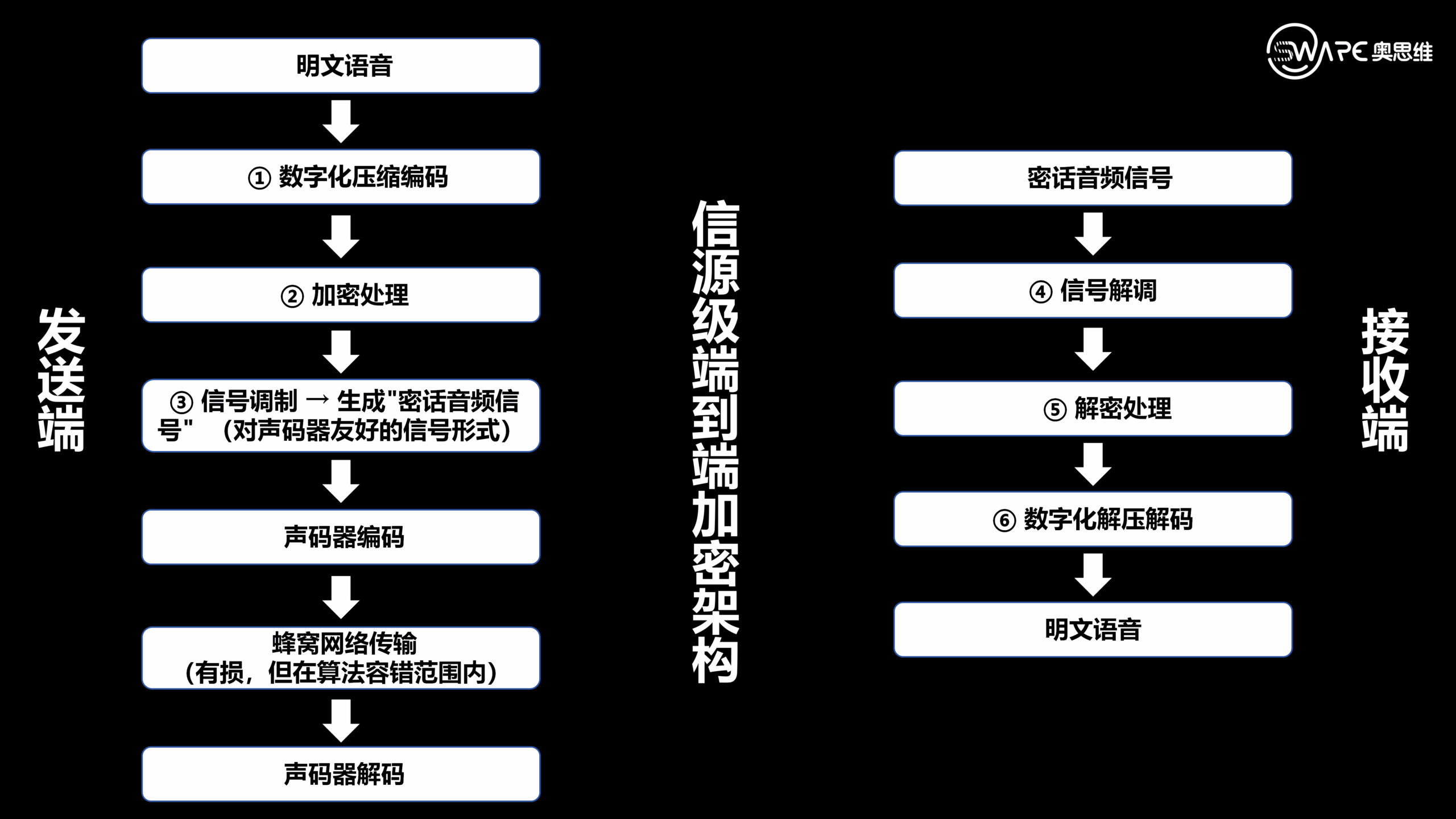

💡 核心突破:让加密数据”伪装”成语音

面对有损传输这个核心瓶颈,关键在于在加密数字流和声码器之间插入一层信号调制解调层。

这层算法的作用,可以这样理解:它不是直接把加密后的数字流丢给声码器(那样会被”压坏”),而是通过信号调制技术,把数字信息编码到一种声码器能够”友好”处理的音频信号形式中。

接收端则通过对应的解调算法,从这个音频信号中还原出加密数字流,再进行解密。

这就是信源级端到端加密——加密发生在音源层面,与后续的传输线路完全无关。无论语音数据经过几次转码、穿越几个运营商的网络,只要损耗在算法的纠错能力范围内,接收端都能完整还原原始语音。

这套方案的技术栈横跨多个领域:语音编码技术、信号调制技术、信号同步技术、频域与时域补偿修正技术、纠错算法等。

✅ 这不是一个”选个加密算法套上去”的工程,而是一个多学科交叉的系统工程,要求团队同时具备操作系统底层开发、信号处理、密码学、通信协议等多个领域的深度能力。

📋 三个关键要点

- 端到端语音加密的核心难度不在”加密”本身,而在于如何在手机的真实硬件架构中,跨越 AP 与 BP 两个世界,统一获取多源语音数据,并满足每帧 20 毫秒的硬实时约束。

- 有损传输是数字加密在电话网络中落地的核心瓶颈。 声码器为人类语音而设计,加密数据对它而言是”噪声”。抗音频压缩干扰的信号调制解调算法,让加密数据能够在有损信道中可靠传输,这是解决问题的关键。

- 这不是一个单点技术突破,而是一个系统工程。 它需要在操作系统内核、芯片驱动、信号处理、密码学和通信协议之间找到精确的平衡点。

技术能在实验室里跑通是一回事,能在运营商网络和量产终端上稳定商用是另一回事。下一篇,小奥和你聊聊语音加密中间件从实验室到商用的工程化之路。

关于小奥 · “小奥”是来自 奥思维(OSWare) 的数字科学家,专注于智能终端操作系统与通信安全技术。

📚 参考来源

[1] Tobias Engel, “SS7: Locate. Track. Manipulate.”, 31st Chaos Communication Congress (31C3), 2014.

[2] “Global Spy Shock: Altamides Surveillance Tool Tracked 14,000 Phones by Exploiting SS7 Protocol”, Meterpreter.

[3] AI Transcription Accuracy Benchmarks 2025, VoiceToNotes.

[4] “The Deepfake CEO Scam: Why Voice Cloning Is the New Business Email Compromise”, SingleSource IT, February 2026.

“